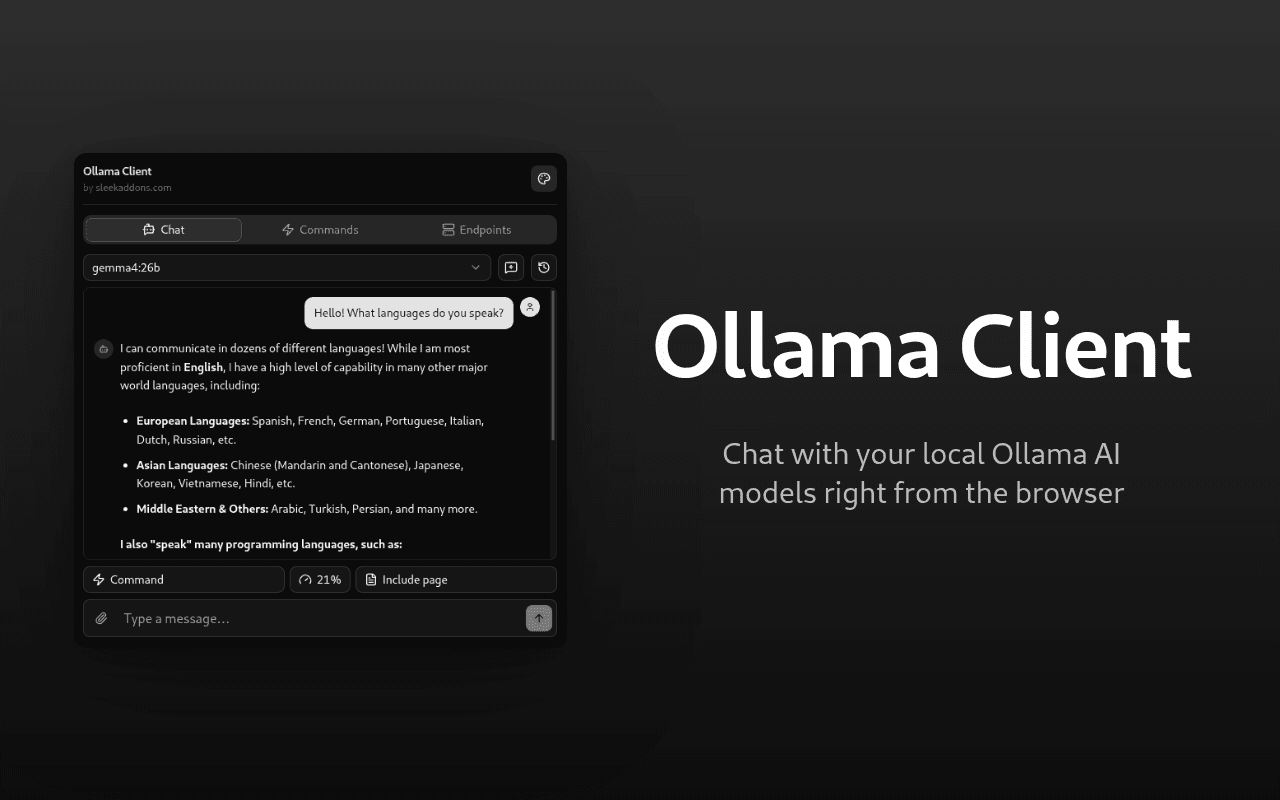

Ollama Client

Общайтесь с локальными AI-моделями Ollama не выходя из браузера

Общайтесь с локальными моделями Ollama прямо из браузера. Подключитесь к своему серверу Ollama и работайте с любой установленной моделью. Никаких облачных сервисов, подписок и передачи данных за пределы вашего устройства.

Как это работает

Откройте всплывающее окно или боковую панель, выберите модель и начните вводить текст. Расширение подключается к локальному серверу Ollama и отправляет ваши сообщения напрямую на него. Вы также можете передать содержимое текущей страницы в ИИ для получения краткого изложения или пояснений.

Возможности

- Все модели на вашем сервере отображаются автоматически, достаточно выбрать нужную

- Отправляйте содержимое текущей страницы в ИИ для пересказа, объяснения или ответов на вопросы по ней

- Прикрепляйте изображения, файлы с кодом, CSV, markdown и другие текстовые форматы

- Встроенные команды «Summarize» и «Explain», а также пользовательские команды, работающие как системные подсказки

- Поддержка нескольких экземпляров Ollama, каждый со своим URL, именем и необязательным токеном авторизации

- Индикатор использования контекста показывает, какую часть контекстного окна модели вы уже заняли

- История разговоров сохраняется локально, что позволяет просматривать прошлые чаты или продолжать с того места, где остановились

- Поддержка боковой панели для общения с ИИ во время просмотра страниц, при этом контекст страницы обновляется при переключении вкладок

- Не требуются аккаунты или API-ключи

Для кого это расширение

Для всех, кто запускает Ollama локально и хочет быстро общаться с моделями, не покидая браузер. Разработчики, авторы, исследователи и все, кто предпочитает локальный ИИ облачным сервисам.

Зачем устанавливать

Лёгкое, полностью приватное расширение, не требующее никаких аккаунтов или подписок. Всё работает локально, и ни один байт ваших данных не покидает устройство.