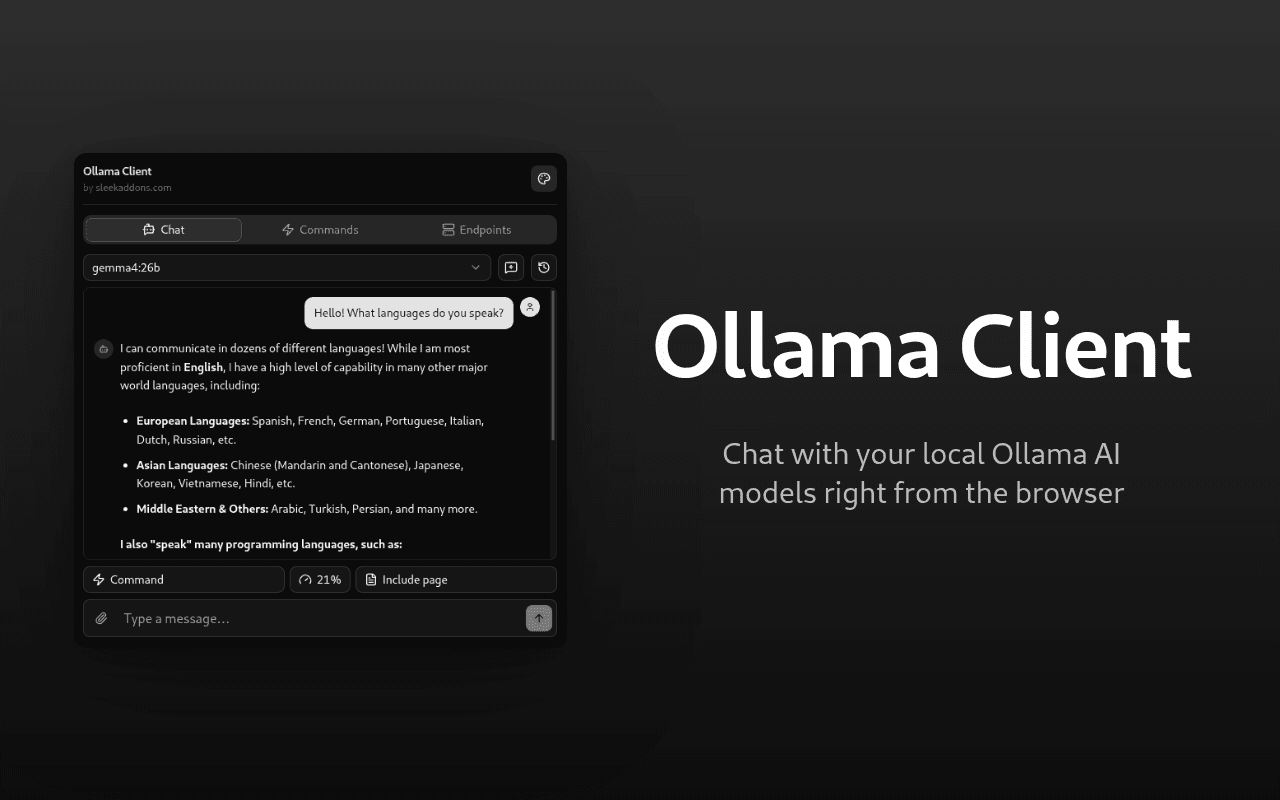

Ollama Client

Converse com os seus modelos de AI Ollama locais sem sair do browser

Converse com seus modelos de IA locais do Ollama diretamente pelo navegador. Conecte-se ao seu servidor Ollama e interaja com qualquer modelo que você tenha instalado. Sem serviços em nuvem, sem assinaturas, sem dados saindo da sua máquina.

Como funciona

Abra o popup ou o painel lateral, escolha um modelo e comece a digitar. A extensão se conecta ao seu servidor Ollama local e envia suas mensagens diretamente para ele. Você também pode enviar o conteúdo da página atual para a IA obter resumos ou explicações.

Funcionalidades

- Selecione entre todos os modelos disponíveis no seu servidor, eles aparecem automaticamente

- Envie a página atual para a IA resumir, explicar ou responder perguntas sobre ela

- Anexe imagens, arquivos de código, CSVs, markdown e outros formatos de texto

- Comandos integrados como Resumir e Explicar, além de comandos personalizados que funcionam como prompts de sistema

- Conecte-se a múltiplas instâncias do Ollama, cada uma com sua própria URL, nome e token de autenticação opcional

- Indicador de uso de contexto mostra quanto da janela de contexto do modelo já foi utilizado

- Histórico de conversas salvo localmente para que você possa consultar chats anteriores ou retomar de onde parou

- Suporte a painel lateral para conversar enquanto navega, com o contexto da página sendo atualizado conforme você troca de aba

- Sem necessidade de contas ou API keys

Para quem é esta extensão

Para qualquer pessoa que rode o Ollama localmente e queira uma forma prática de conversar com modelos sem sair do navegador. Desenvolvedores, escritores, pesquisadores e todos que preferem IA local a serviços em nuvem.

Por que instalar

Leve, totalmente privada e funciona sem nenhuma conta ou assinatura. Tudo roda localmente e nenhum dado sai do seu dispositivo.