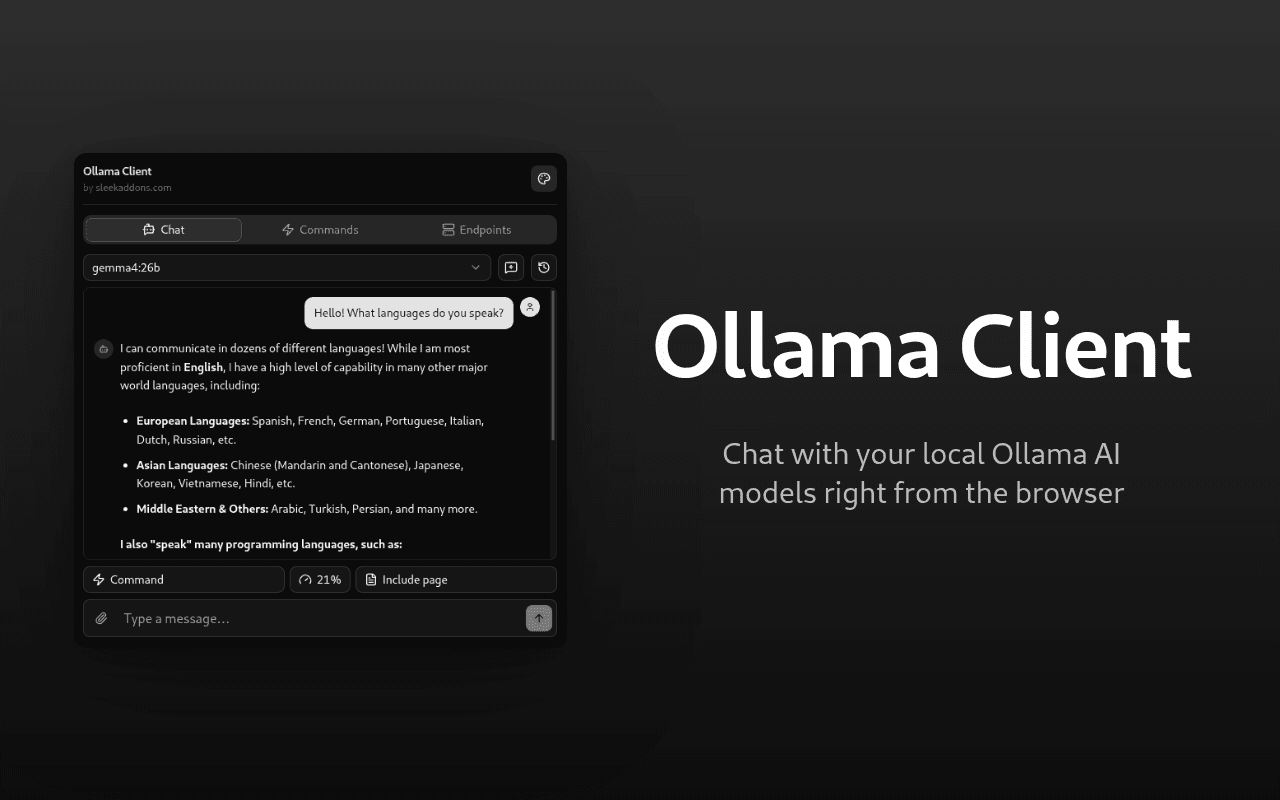

Ollama Client

Rozmawiaj z lokalnymi modelami AI Ollama bez wychodzenia z przeglądarki

Rozmawiaj z lokalnymi modelami Ollama AI bezpośrednio z poziomu przeglądarki. Połącz się ze swoim serwerem Ollama i korzystaj z dowolnego zainstalowanego modelu. Żadnych usług w chmurze, żadnych subskrypcji, żadnych danych opuszczających Twój komputer.

Jak to działa

Otwórz wyskakujące okienko lub panel boczny, wybierz model i zacznij pisać. Rozszerzenie łączy się z lokalnym serwerem Ollama i przesyła wiadomości bezpośrednio do niego. Możesz też wysłać zawartość aktualnie otwartej strony do AI, aby uzyskać jej streszczenie lub wyjaśnienie.

Funkcje

- Wybieraj spośród wszystkich modeli dostępnych na serwerze, które pojawiają się automatycznie

- Wysyłaj zawartość bieżącej strony do AI, aby ją streścić, wyjaśnić lub zadać pytania na jej temat

- Dołączaj obrazy, pliki z kodem, pliki CSV, markdown i inne formaty tekstowe

- Wbudowane polecenia takie jak Summarize i Explain, a także własne polecenia działające jako systemowe podpowiedzi

- Obsługa wielu instancji Ollama, każda z własnym adresem URL, nazwą i opcjonalnym tokenem uwierzytelniającym

- Wskaźnik wykorzystania kontekstu pokazuje, ile okna kontekstowego modelu zostało już zajęte

- Historia rozmów zapisywana lokalnie, dzięki czemu możesz przeglądać poprzednie czaty lub kontynuować je od miejsca, w którym skończyłeś

- Obsługa panelu bocznego umożliwia rozmowę podczas przeglądania stron, a kontekst strony aktualizuje się przy każdej zmianie karty

- Nie wymaga kont ani kluczy API

Dla kogo jest to rozszerzenie

Dla każdego, kto uruchamia Ollama lokalnie i chce szybko rozmawiać z modelami bez wychodzenia z przeglądarki. Dla programistów, pisarzy, badaczy i wszystkich, którzy wolą lokalne AI od usług w chmurze.

Dlaczego warto je zainstalować

Lekkie, w pełni prywatne i działające bez żadnych kont ani subskrypcji. Wszystko działa lokalnie, a żadne dane nigdy nie opuszczają Twojego urządzenia.