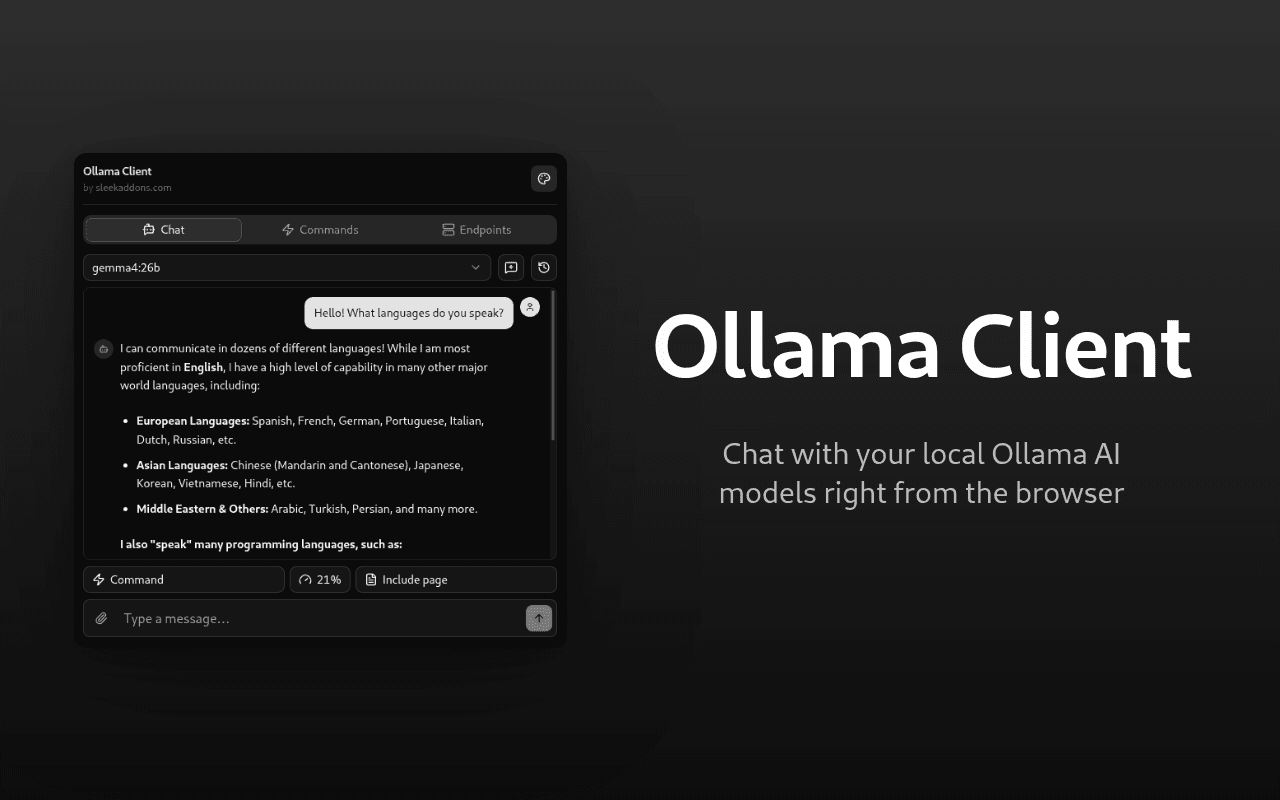

Ollama Client

Chat met je lokale Ollama AI-modellen rechtstreeks vanuit de browser

Chat met je lokale Ollama AI-modellen rechtstreeks vanuit de browser. Verbind met je Ollama-server en praat met elk model dat je hebt geïnstalleerd. Geen clouddiensten, geen abonnementen, geen data die je apparaat verlaat.

Hoe het werkt

Open de popup of het zijpaneel, kies een model en begin met typen. De extensie maakt verbinding met je lokale Ollama-server en stuurt je berichten er rechtstreeks naartoe. Je kunt ook de inhoud van de huidige pagina naar de AI sturen voor samenvattingen of uitleg.

Functies

- Kies uit alle modellen op je server, ze verschijnen automatisch in de lijst

- Stuur de huidige pagina naar de AI om samen te vatten, uit te leggen of vragen over te beantwoorden

- Voeg afbeeldingen, codebestanden, CSV's, markdown en andere tekstformaten toe

- Ingebouwde opdrachten zoals Samenvatten en Uitleggen, plus aangepaste opdrachten die als systeemprompts fungeren

- Verbind met meerdere Ollama-instanties, elk met een eigen URL, naam en optioneel auth-token

- Een contextmeter toont hoeveel van het contextvenster van het model je al hebt gebruikt

- Gespreksgeschiedenis wordt lokaal opgeslagen, zodat je eerdere chats kunt terugvinden of verder kunt gaan waar je gebleven was

- Ondersteuning voor het zijpaneel, zodat je kunt chatten terwijl je surft, met pagina-context die automatisch bijwerkt als je van tabblad wisselt

- Geen accounts of API-sleutels vereist

Voor wie is dit bedoeld

Voor iedereen die Ollama lokaal draait en snel met modellen wil chatten zonder de browser te verlaten. Ontwikkelaars, schrijvers, onderzoekers en iedereen die de voorkeur geeft aan lokale AI boven clouddiensten.

Waarom installeren

Lichtgewicht, volledig privé en werkt zonder accounts of abonnementen. Alles draait lokaal en er verlaat nooit data je apparaat.