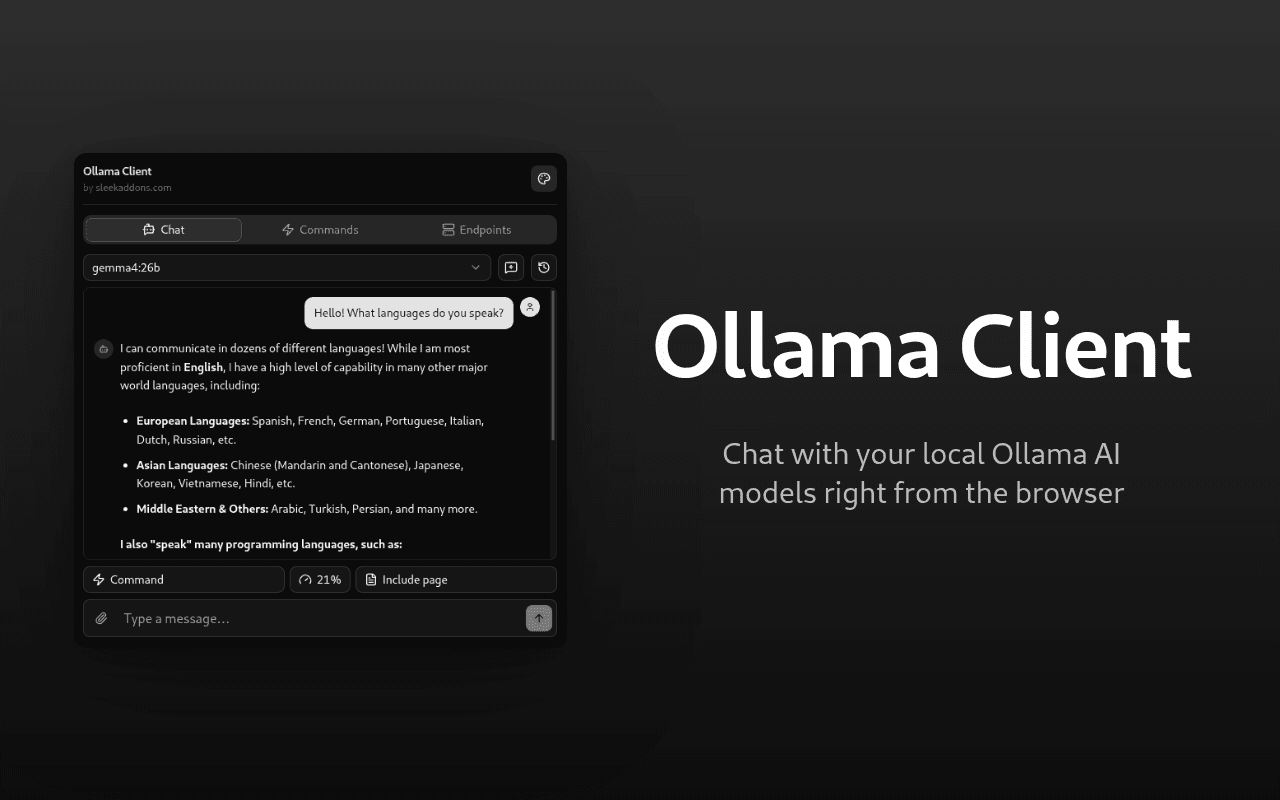

Ollama Client

Chatta con i tuoi modelli AI Ollama locali direttamente dal browser

Chatta con i tuoi modelli AI Ollama locali direttamente dal browser. Collegati al tuo server Ollama e conversa con qualsiasi modello installato. Nessun servizio cloud, nessun abbonamento, nessun dato che lascia il tuo dispositivo.

Come funziona

Apri il popup o il pannello laterale, scegli un modello e inizia a scrivere. L'estensione si connette al tuo server Ollama locale e gli invia i tuoi messaggi direttamente. Puoi anche inviare il contenuto della pagina corrente all'AI per ottenere riepiloghi o spiegazioni.

Funzionalità

- Tutti i modelli presenti sul tuo server vengono rilevati automaticamente e sono subito disponibili per la selezione

- Invia la pagina corrente all'AI per riassumerla, spiegarla o fare domande sul suo contenuto

- Allega immagini, file di codice, CSV, markdown e altri formati di testo

- Comandi integrati come Riepiloga e Spiega, oltre a comandi personalizzati che fungono da prompt di sistema

- Connettiti a più istanze Ollama, ognuna con il proprio URL, nome e token di autenticazione opzionale

- Un indicatore di utilizzo del contesto mostra quanta parte della finestra di contesto del modello hai già occupato

- La cronologia delle conversazioni viene salvata in locale, così puoi sfogliare le chat precedenti o riprendere da dove avevi lasciato

- Supporto al pannello laterale per chattare mentre navighi, con il contesto della pagina che si aggiorna automaticamente al cambio di scheda

- Nessun account o chiave API richiesta

A chi è rivolto

A chiunque utilizzi Ollama in locale e voglia un modo rapido per interagire con i modelli senza abbandonare il browser. Sviluppatori, scrittori, ricercatori e chiunque preferisca un'AI locale ai servizi cloud.

Perché installarlo

Leggero, completamente privato e utilizzabile senza account né abbonamenti. Tutto viene eseguito in locale e nessun dato lascia mai il tuo dispositivo.