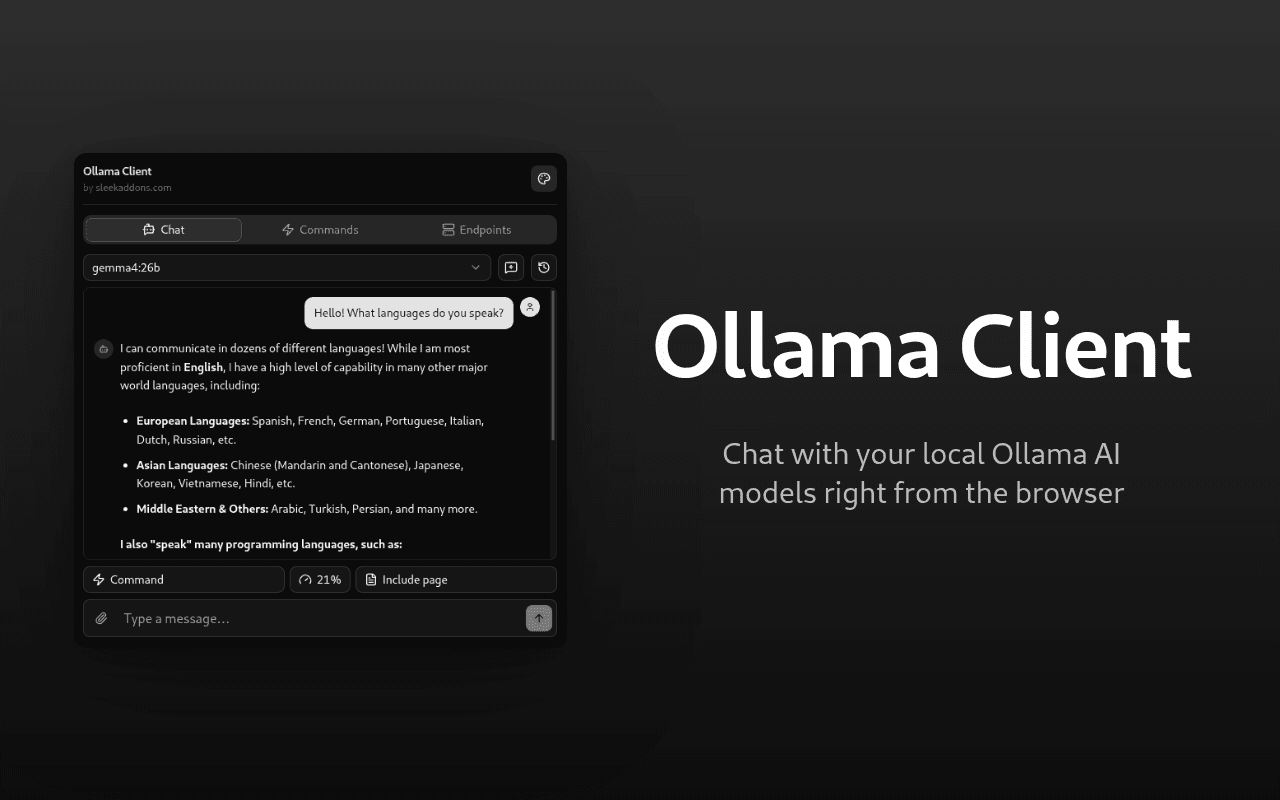

Ollama Client

Discutez avec vos modèles Ollama AI en local sans quitter le navigateur

Chattez avec vos modèles Ollama en local directement depuis le navigateur. Connectez-vous à votre serveur Ollama et discutez avec n'importe quel modèle installé. Aucun service cloud, aucun abonnement, aucune donnée ne quitte votre machine.

Fonctionnement

Ouvrez le popup ou le panneau latéral, choisissez un modèle et commencez à écrire. L'extension se connecte à votre serveur Ollama local et lui transmet vos messages directement. Vous pouvez également envoyer le contenu de la page en cours à l'IA pour obtenir un résumé ou des explications.

Fonctionnalités

- Accédez à tous les modèles disponibles sur votre serveur, ils apparaissent automatiquement

- Envoyez la page en cours à l'IA pour la résumer, l'expliquer ou poser des questions à son sujet

- Joignez des images, des fichiers de code, des CSV, du markdown et d'autres formats texte

- Commandes intégrées comme Résumer et Expliquer, ainsi que des commandes personnalisées qui servent de prompts système

- Connectez-vous à plusieurs instances Ollama, chacune avec sa propre URL, son nom et un token d'authentification optionnel

- Une jauge d'utilisation du contexte indique quelle part de la fenêtre de contexte du modèle vous avez consommée

- L'historique des conversations est sauvegardé localement pour retrouver vos échanges passés ou reprendre là où vous en étiez

- Prise en charge du panneau latéral pour discuter tout en naviguant, avec le contexte de page qui se met à jour à chaque changement d'onglet

- Aucun compte ni clé API requis

À qui s'adresse cette extension

À toute personne qui utilise Ollama en local et souhaite interagir avec ses modèles sans quitter le navigateur. Développeurs, rédacteurs, chercheurs et tous ceux qui préfèrent une IA locale aux services cloud.

Pourquoi l'installer

Légère, entièrement privée et utilisable sans compte ni abonnement. Tout s'exécute en local et aucune donnée ne quitte jamais votre appareil.