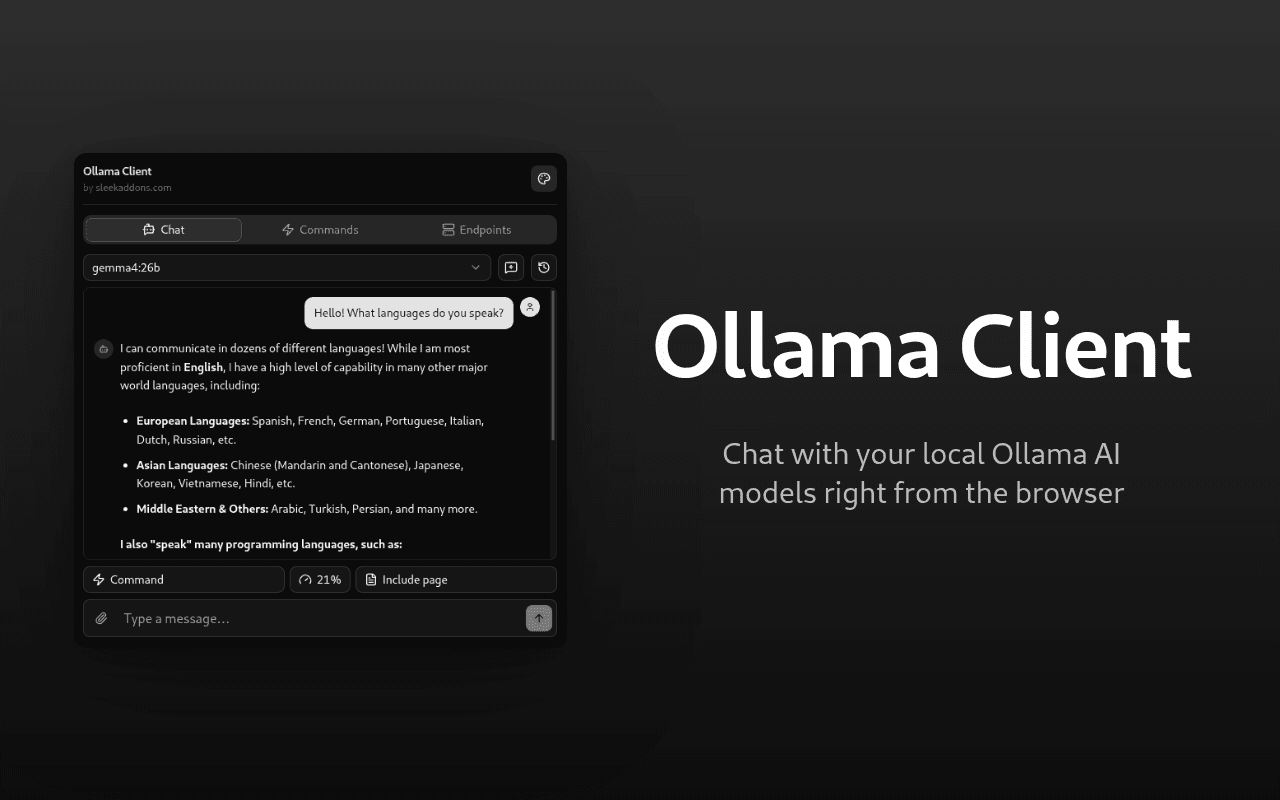

Ollama Client

Chatea con tus modelos de AI de Ollama locales directamente desde el navegador

Chatea con tus modelos de IA locales de Ollama directamente desde el navegador. Conéctate a tu servidor de Ollama y conversa con cualquier modelo que tengas instalado. Sin servicios en la nube, sin suscripciones, sin que tus datos salgan de tu equipo.

Cómo funciona

Abre el popup o el panel lateral, elige un modelo y empieza a escribir. La extensión se conecta a tu servidor local de Ollama y le envía tus mensajes directamente. También puedes enviarle el contenido de la página actual para que lo resuma o lo explique.

Funcionalidades

- Selecciona entre todos los modelos disponibles en tu servidor, aparecen automáticamente

- Envía la página actual a la IA para resumirla, explicarla o hacerle preguntas sobre su contenido

- Adjunta imágenes, archivos de código, CSVs, markdown y otros formatos de texto

- Comandos integrados como Resumir y Explicar, además de comandos personalizados que funcionan como system prompts

- Conéctate a varias instancias de Ollama, cada una con su propia URL, nombre y token de autenticación opcional

- Un indicador de uso del contexto muestra cuánto del context window del modelo has utilizado

- El historial de conversaciones se guarda localmente para que puedas consultar chats anteriores o retomar donde lo dejaste

- Compatibilidad con el panel lateral para chatear mientras navegas, con el contexto de página que se actualiza al cambiar de pestaña

- No se necesitan cuentas ni API keys

Para quién es esta extensión

Para cualquier persona que ejecute Ollama en local y quiera una forma rápida de chatear con modelos sin salir del navegador. Desarrolladores, escritores, investigadores y cualquiera que prefiera la IA local a los servicios en la nube.

Por qué instalarla

Ligera, completamente privada y funciona sin cuentas ni suscripciones. Todo se ejecuta en local y ningún dato abandona tu dispositivo.