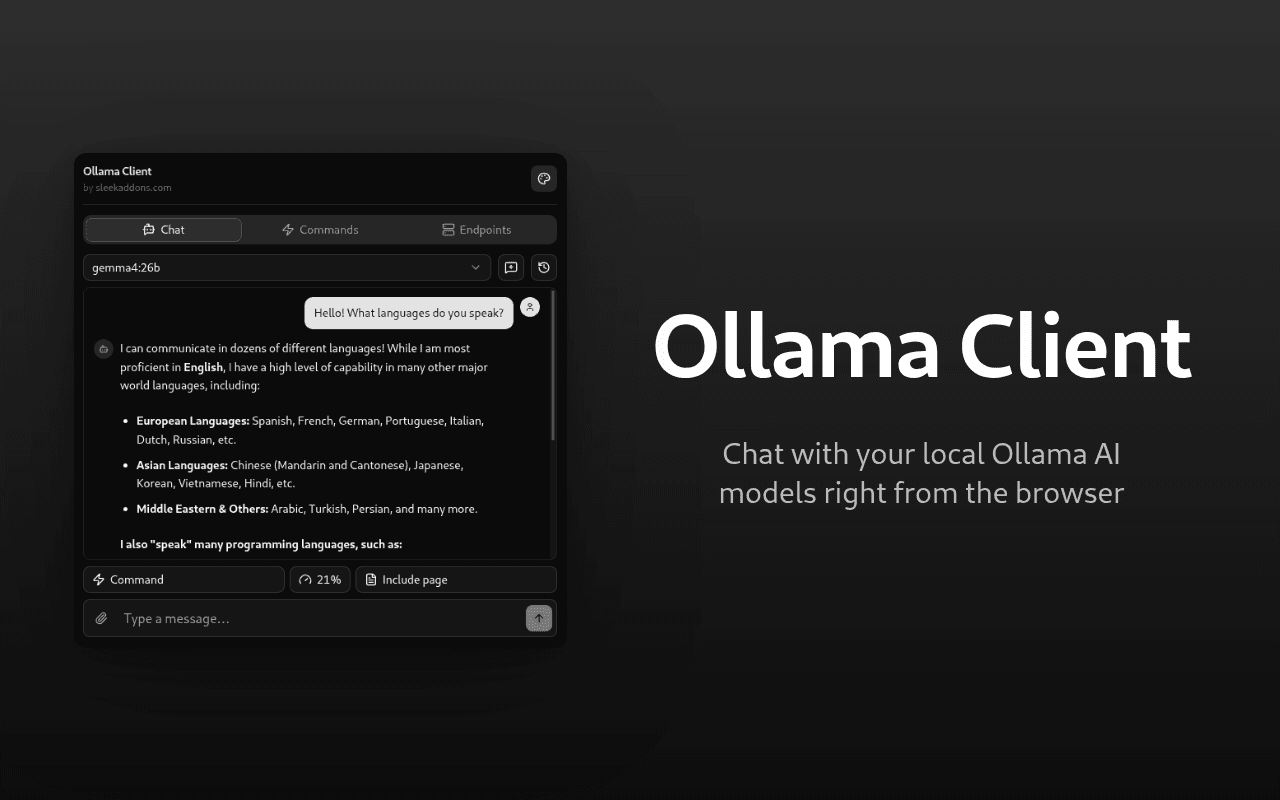

Ollama Client

Direkt im Browser mit lokalen Ollama AI-Modellen chatten

Mit deinen lokalen Ollama-KI-Modellen direkt im Browser chatten. Verbinde dich mit deinem Ollama-Server und sprich mit jedem installierten Modell. Keine Cloud-Dienste, keine Abonnements, keine Daten verlassen deinen Rechner.

So funktioniert es

Öffne das Popup oder das Seitenpanel, wähle ein Modell aus und fang an zu schreiben. Die Erweiterung stellt eine Verbindung zu deinem lokalen Ollama-Server her und schickt deine Nachrichten direkt dorthin. Du kannst auch den Inhalt der aktuellen Seite an die KI senden, um Zusammenfassungen oder Erklärungen zu erhalten.

Funktionen

- Alle Modelle auf deinem Server werden automatisch angezeigt und stehen zur Auswahl bereit

- Den Inhalt der aktuellen Seite an die KI senden, um ihn zusammenzufassen, zu erklären oder Fragen dazu zu stellen

- Bilder, Code-Dateien, CSVs, Markdown und andere Textformate anhängen

- Integrierte Befehle wie Zusammenfassen und Erklären sowie eigene Befehle, die als Systemprompts fungieren

- Mehrere Ollama-Instanzen verbinden, jede mit eigener URL, eigenem Namen und optionalem Auth-Token

- Eine Kontextanzeige zeigt, wie viel des Kontextfensters des Modells bereits genutzt wurde

- Der Gesprächsverlauf wird lokal gespeichert, sodass du frühere Chats durchsuchen oder dort weitermachen kannst, wo du aufgehört hast

- Unterstützung für das Seitenpanel, damit du beim Surfen chatten kannst, während der Seitenkontext beim Wechseln von Tabs automatisch aktualisiert wird

- Keine Konten oder API-Schlüssel erforderlich

Für wen ist das gedacht

Für alle, die Ollama lokal betreiben und eine schnelle Möglichkeit suchen, mit Modellen zu chatten, ohne den Browser zu verlassen. Entwickler, Autoren, Forscher und alle, die lokale KI Cloud-Diensten vorziehen.

Warum installieren

Schlank, vollständig privat und ohne Konten oder Abonnements nutzbar. Alles läuft lokal und keine Daten verlassen jemals dein Gerät.