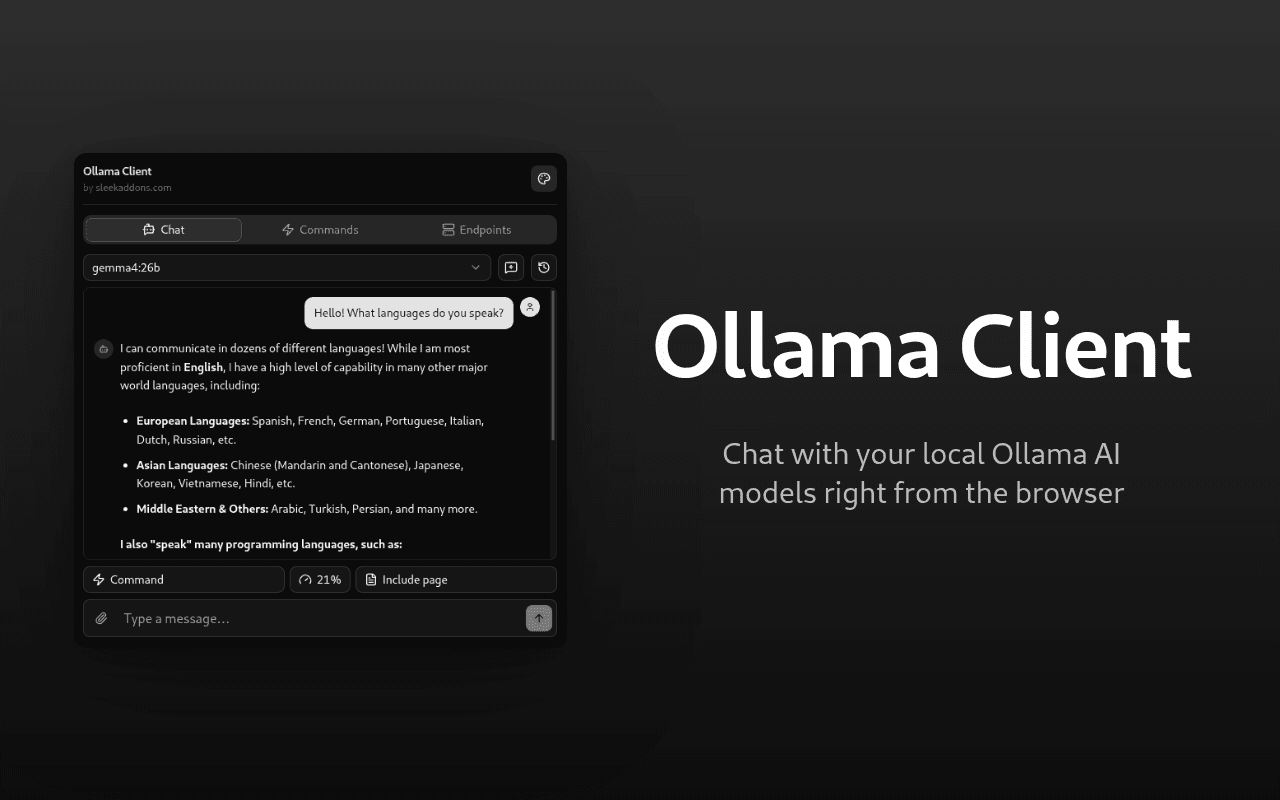

Ollama Client

Chatujte s lokálními Ollama AI modely přímo v prohlížeči

Chatujte se svými lokálními AI modely Ollama přímo z prohlížeče. Připojte se ke svému Ollama serveru a povídejte si s libovolným nainstalovaným modelem. Žádné cloudové služby, žádná předplatná, žádná data neopouštějí váš počítač.

Jak to funguje

Otevřete popup nebo boční panel, vyberte model a začněte psát. Rozšíření se připojí k vašemu lokálnímu Ollama serveru a odesílá zprávy přímo na něj. Obsah aktuální stránky můžete také předat AI, která ho shrne nebo vysvětlí.

Funkce

- Výběr ze všech modelů na vašem serveru, které se zobrazují automaticky

- Odeslání obsahu aktuální stránky AI ke shrnutí, vysvětlení nebo zodpovězení otázek

- Připojení obrázků, souborů s kódem, CSV souborů, markdownu a dalších textových formátů

- Vestavěné příkazy jako Shrnutí a Vysvětlení, plus vlastní příkazy fungující jako systémové prompty

- Připojení k více instancím Ollama, každá s vlastní URL adresou, názvem a volitelným autentizačním tokenem

- Ukazatel využití kontextu zobrazující, kolik z kontextového okna modelu jste již využili

- Historie konverzací uložená lokálně, takže můžete procházet minulé chaty nebo navázat tam, kde jste skončili

- Podpora bočního panelu umožňující chatovat při prohlížení webu, přičemž kontext stránky se aktualizuje při přepínání záložek

- Bez nutnosti účtů nebo API klíčů

Pro koho je toto rozšíření určeno

Pro každého, kdo provozuje Ollama lokálně a chce rychlý způsob, jak komunikovat s modely bez opuštění prohlížeče. Vývojáři, autoři, výzkumníci a všichni, kteří dávají přednost lokální AI před cloudovými službami.

Proč si ho nainstalovat

Nenáročné na zdroje, plně soukromé a funguje bez jakýchkoli účtů nebo předplatných. Vše běží lokálně a žádná data nikdy neopustí vaše zařízení.